OpenAI опубликовала ответ на иск The New York Times, утверждая, что The NYTimes использовала манипулятивные методы подсказки, чтобы побудить ChatGPT извергать длинные отрывки, заявив, что иск основан на неправильном использовании ChatGPT с целью «отбирать вишенные» примеры для иск.

Содержание

Иск New York Times против OpenAI

The New York Times подала иск против OpenAI (и Microsoft) за нарушение авторских прав, утверждая, что ChatGPT «дословно цитирует контент Times», среди других жалоб.

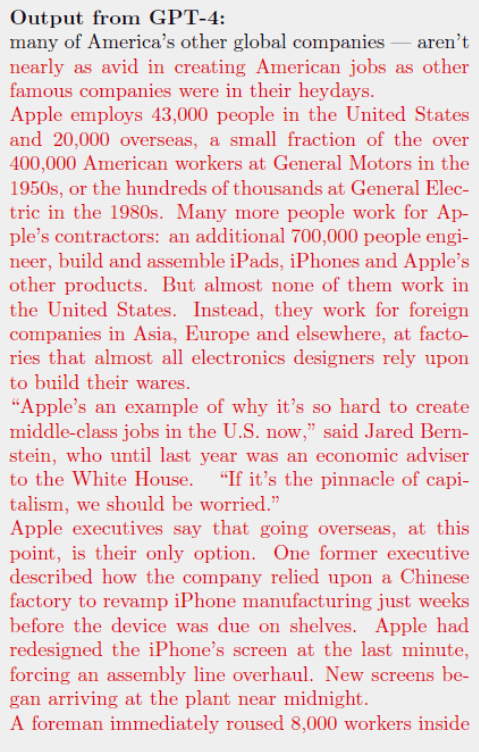

В иске были представлены доказательства того, что GPT-4 может выводить большие объемы контента New York Times без указания авторства, в качестве доказательства того, что GPT-4 нарушает контент The New York Times.

Обвинение в том, что GPT-4 выводит точные копии контента New York Times, важно, поскольку оно противоречит утверждению OpenAI о том, что использование данных является преобразующим, что является правовой основой, связанной с доктриной добросовестного использования.

Бюро регистрации авторских прав США определяет добросовестное использование контента, защищенного авторским правом, который преобразует:

«Справедливое использование — это правовая доктрина, которая способствует свободе выражения мнений, разрешая при определенных обстоятельствах нелицензионное использование произведений, защищенных авторским правом.

… «преобразующее» использование с большей вероятностью будет считаться справедливым. Трансформационное использование — это такое использование, которое добавляет что-то новое, имеющее дополнительную цель или другой характер, и не заменяет первоначальное использование произведения».

Вот почему для The New York Times важно заявить, что использование контента OpenAI не является добросовестным.

Иск New York Times против OpenAI состояния:

«Обвиняемые настаивают на том, что их поведение защищено как «добросовестное использование», поскольку нелицензионное использование ими контента, защищенного авторским правом, для обучения моделей GenAI служит новой «преобразующей» цели. Но в использовании контента The Times нет ничего «преобразующего»… Поскольку результаты моделей GenAI Ответчиков конкурируют и близко имитируют входные данные, используемые для их обучения, копирование работ Times для этой цели не является добросовестным использованием».

На следующем снимке экрана показано, как GPT-4 выводит точную копию контента Times. Контент, выделенный красным, — это оригинальный контент, созданный New York Times и выведенный с помощью GPT-4.

Ответ OpenAI опровергает иски NYTimes

OpenAI решительно опровергла утверждения, высказанные в иске New York Times, заявив, что решение Times обратиться в суд удивило OpenAI, поскольку они предполагали, что переговоры продвигаются к решению.

Самое главное, OpenAI опровергла утверждения The New York Times о том, что GPT-4 выводит дословный контент, объяснив, что GPT-4 предназначен для того, чтобы не выводить дословный контент, и что The New York Times использовала методы подсказок, специально разработанные для преодоления барьеров GPT-4, чтобы выдать спорный вывод, что опровергает утверждение The New York Times о том, что вывод дословного контента является обычным выводом GPT-4.

Этот тип подсказок, предназначенный для взлома ChatGPT с целью создания нежелательного вывода, известен как состязательные подсказки.

Состязательные атаки

Генеративный ИИ чувствителен к типам подсказок (запросов), поступающих к нему, и, несмотря на все усилия инженеров по блокированию злоупотреблений генеративным ИИ, все еще существуют новые способы использования подсказок для генерации ответов, которые обходят барьеры, встроенные в технологию, которая предназначены для предотвращения нежелательного вывода.

Методы создания непреднамеренного вывода называются состязательными подсказками, и именно в этом OpenAI обвиняет The New York Times, чтобы создать основу для доказательства того, что использование GPT-4 контента, защищенного авторским правом, не является преобразующим.

Заявление OpenAI о том, что The New York Times неправильно использовала GPT-4, важно, поскольку оно подрывает инсинуацию иска о том, что создание дословного контента, защищенного авторским правом, является типичным поведением.

Подобные состязательные побуждения также нарушают Условия использования OpenAI в котором говорится:

Чего ты не можешь сделать

- Используйте наши Сервисы таким образом, чтобы ущемлять, присваивать или нарушать чьи-либо права.

- Вмешиваться в работу наших Сервисов или нарушать их работу, в том числе обходить любые лимиты или ограничения, а также обходить любые защитные меры или меры по снижению безопасности, которые мы налагаем на наши Сервисы.

OpenAI подает иск на основании манипулируемых подсказок

В опровержении OpenAI утверждается, что газета New York Times использовала манипулируемые подсказки, специально разработанные для обхода барьеров GPT-4, чтобы генерировать дословный контент.

ОпенАИ пишет:

«Похоже, что они намеренно манипулировали подсказками, часто включая длинные выдержки из статей, чтобы заставить нашу модель срыгивать.

Даже при использовании таких подсказок наши модели обычно не ведут себя так, как намекает The New York Times, что позволяет предположить, что они либо дали модели возможность срыгнуть, либо выбрали примеры из множества попыток».

OpenAI также ответила на иск The New York Times, заявив, что методы, используемые The New York Times для создания дословного контента, являются нарушением разрешенной активности пользователей и неправомерным использованием.

Они пишут:

«Несмотря на их заявления, такое неправильное использование не является типичной или разрешенной деятельностью пользователя».

В заключение OpenAI заявила, что они продолжают укреплять сопротивление тем видам состязательных оперативных атак, которые использует The New York Times.

Они пишут:

«Несмотря на это, мы постоянно делаем наши системы более устойчивыми к состязательным атакам, направленным на извлечение обучающих данных, и уже добились большого прогресса в наших последних моделях».

OpenAI подкрепила свое заявление о тщательном соблюдении авторских прав, сославшись на свой ответ от июля 2023 года на сообщения о том, что ChatGPT генерирует дословные ответы.

Мы узнали, что бета-версия ChatGPT «Обзор» может иногда отображать контент нежелательными для нас способами, например, если пользователь специально запрашивает полный текст URL-адреса, он может непреднамеренно выполнить этот запрос. Пока мы исправляем эту проблему, мы отключаем просмотр — хотим, чтобы владельцы контента поступали правильно.

— OpenAI (@OpenAI) 4 июля 2023 г.

The New York Times против OpenAI

Всегда есть две стороны истории, и OpenAI только что опубликовала свою версию, которая показывает, что претензии The New York Times основаны на состязательных атаках и неправильном использовании ChatGPT с целью получения дословных ответов.

Прочтите ответ OpenAI:

OpenAI и журналистика:

Мы поддерживаем журналистику, сотрудничаем с новостными организациями и считаем, что иск The New York Times необоснован.

Рекомендованное изображение: Shutterstock/pizzastereo